为企业客户提供一站式的IT设备采购服务

全国咨询热线:

400-6009-602

400-6009-602

若将此番发布仅视为“新一代服务器CPU”,未免失之浅表。其真正意义,在于计算架构范式、数据中心调度逻辑以及半导体商业模式的三重重构。

这不是一次产品迭代,而是一场关于“谁主导AI算力底座”的结构性迁移。

过去数年,AI基础设施形成一种近乎共识的结构:

GPU主算力 + CPU辅助调度

但在“代理式AI(Agentic AI)”场景中,这一模型正在松动:

GPU的瓶颈不再是算力本身,而是:

而这两者,本质皆依赖CPU。

在现代AI数据中心中,CPU承担四大关键角色:

因此趋势已然改变:

CPU不再是辅助单元,而是AI系统的“操作系统级核心”

136个Neoverse V3核心,并非简单堆叠,而是面向以下场景:

其设计目标不是单任务性能,而是:

最大化系统吞吐(Throughput-first architecture)

x86体系普遍采用SMT(超线程),以提高资源利用率,但也带来副作用:

Arm AGI CPU采用:

1线程 = 1核心(无SMT)

带来的技术优势:

在AI推理场景中:

P99延迟往往比平均性能更关键

关键指标:

这揭示一个核心趋势:

AI系统正从“算力受限”转向“内存受限”

典型瓶颈包括:

Arm的优化方向:

本质上是在回答一个问题:

如何让数据跟上计算,而不是拖累计算

在300W功耗约束下实现高密度计算,其核心并非“更强”,而是“更省”:

技术基础包括:

对比x86:

因此竞争焦点已转移:

从性能竞赛,转向“单位能耗算力竞赛”

Arm给出关键能力:

这意味着计算单位的跃迁:

从“服务器级”走向“机架级”

带来系统级变化:

数据中心正在从“机器集合”演化为“计算整体”。

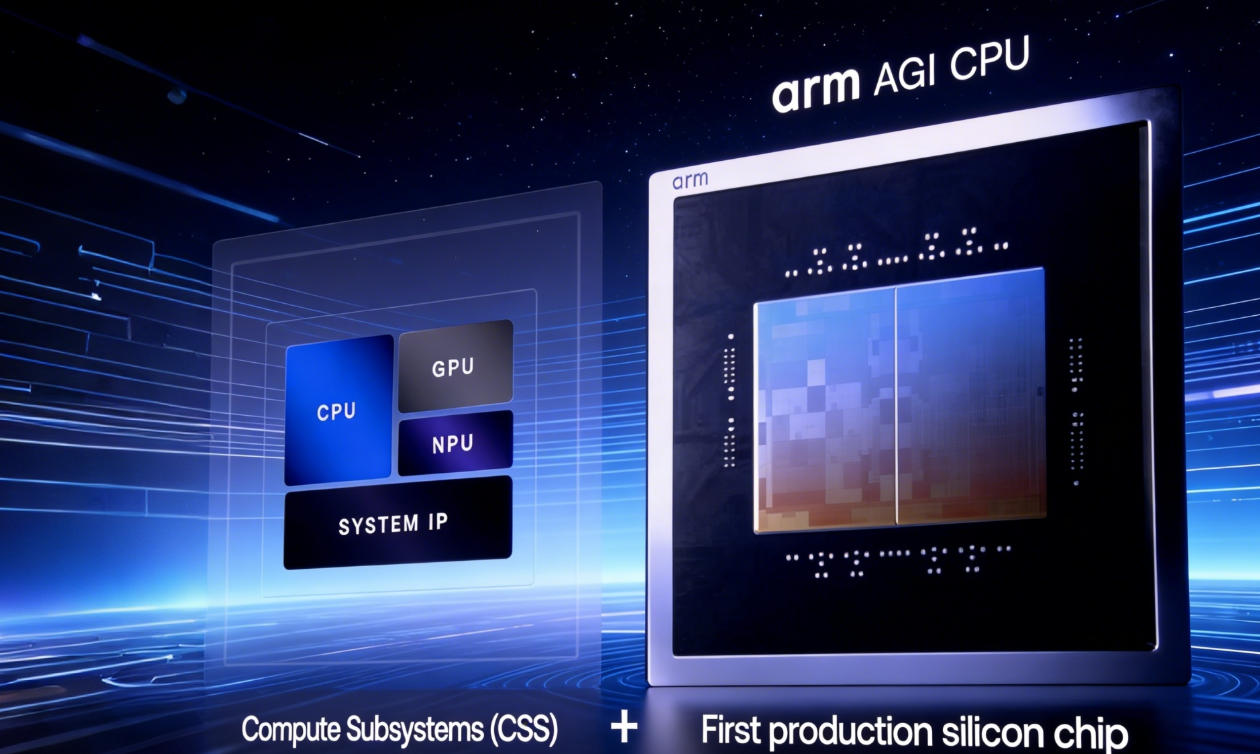

未来标准架构将趋于:

Arm CPU —— 控制与调度

↓

GPU / TPU / ASIC —— 计算执行

↓

HBM / CXL Memory —— 数据支撑

关键技术支点:

Arm CPU的角色本质是:

系统调度中枢 + 内存协调核心

Agentic AI带来新计算模式:

每个Token背后意味着:

结论非常直接:

Token越多,CPU越忙

这也是CPU需求增长4倍的根本原因。

Arm过去模式:

现在模式:

这是一种典型转型:

从“规则制定者”走向“市场参与者”

对标路径:

其本质,是争夺:

产业价值链上游控制权

Arm的结构性优势逐渐显现:

x86的劣势在AI场景中被放大:

趋势或将演变为:

x86守通用计算,Arm主导AI数据中心

典型案例:

核心动因:

Arm提供的价值:

可定制、可扩展、可控的计算底座

当前关系:

潜在张力:

未来可能出现:

“CPU主导架构” vs “GPU主导架构”之争

这将决定AI基础设施的权力归属。

归根结底,这不是一颗芯片的问题,而是三件事的重写:

可以用一句话作结:

Arm试图用“能效与架构简洁性”,重构AI时代的算力秩序。